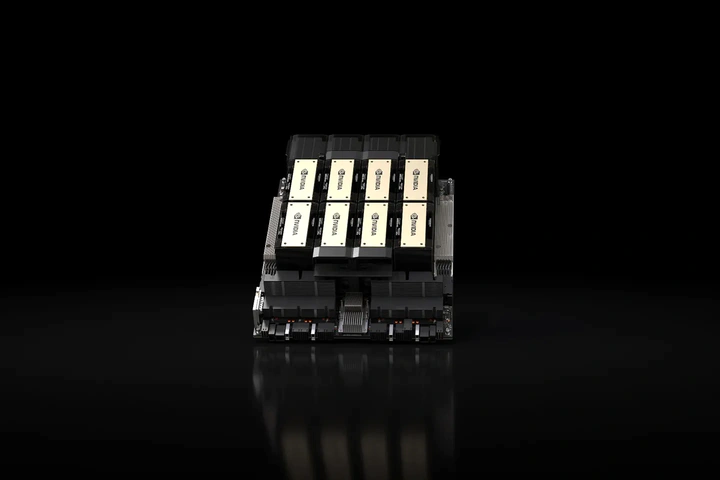

當(dāng)?shù)貢r(shí)間周一,英偉達(dá)宣布推出 NVIDIA HGX™ H200,為全球領(lǐng)先的 AI 計(jì)算平臺帶來強(qiáng)大動(dòng)力。

該平臺基于 NVIDIA Hopper™ 架構(gòu),是 H100 GPU 的繼任者,也是該公司首款使用 HBM3e 內(nèi)存的芯片,可加速生成式 AI 和大型語言模型,同時(shí)推進(jìn) HPC 工作負(fù)載的科學(xué)計(jì)算。

借助 HBM3e,英偉達(dá) H200 以每秒 4.8 TB 的速度提供 141GB 內(nèi)存,與 A100 相比,容量幾乎翻倍,帶寬增加 2.4 倍。

H200 的推出將帶來進(jìn)一步的性能飛躍,在 Llama 2 上的推理速度比 H100 快一倍。英偉達(dá)表示,未來的軟件更新預(yù)計(jì)會(huì)帶來 H200 的額外性能領(lǐng)先優(yōu)勢和改進(jìn)。

英偉達(dá) H200 芯片將于 2024 年第二季度開始向全球系統(tǒng)制造商和云服務(wù)提供商供貨。